|

0

0

|

Indeksowanie spadło — to częściej decyzja Google niż błąd treści |

Spadek liczby zaindeksowanych URL o ~72% w 48 godzin to alarm dla każdego właściciela serwisu. Najpierw musisz sprawdzić Statystyki indeksowania w Search Console i logi serwera, potem priorytetyzować naprawy: dostępność, sitemap, canonical, parametry. Często problem nie leży w jakości treści, lecz w mechanice alokacji budżetu indeksowania i sygnałach dla Googlebota.

Zrzut ekranu z raportu „Statystyki indeksowania” pokazał klientowi z Warszawy spadek z 24 000 do ~6 700 zaindeksowanych stron w dwa dni — 72% mniej, czas reakcji: natychmiastowa diagnostyka.

Co powoduje nagłe spadki liczby zaindeksowanych URL

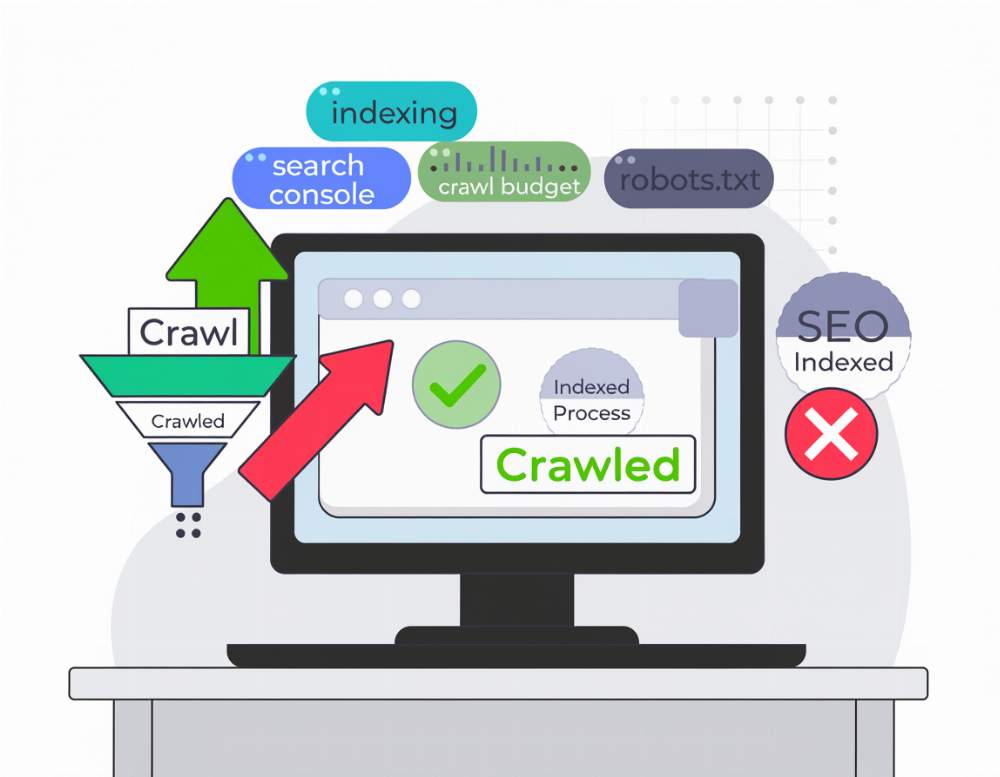

Nie ma jednej przyczyny. robots.txt blokujący katalog, masowe odpowiedzi 5xx, niepoprawne przekierowania 301 -> 404, błędne tagi rel="canonical", błędna mapa strony sitemap.xml, lub nagła utrata linków wewnętrznych wpływają na to, które URL Google wybiera do crawlowania. Termin budżet indeksowania (crawl budget) oznacza praktycznie liczbę żądań, które Googlebot wykonuje na Twojej domenie w określonym czasie i jest alokowany dynamicznie na podstawie dostępności serwera i zapotrzebowania.

Jak szybko zdiagnozować problem z indeksowaniem

Najpierw otwórz Search Console: raporty o błędach crawlowania i Statystyki indeksowania — sprawdź spadki i korelacje czasowe z wdrożeniami. Równolegle pobierz logi serwera i przefiltruj je pod kątem Googlebota (user agent i adresy IP). Sprawdź zwracane kody HTTP dla grupy URL, hakowanie nagłówków, wielokrotne 5xx. Uwaga na parametry w URL (sessionid, sort, filter) — nadmiar wariantów przejada budżet.

W jednym z naszych przypadków sklepu po migracji cały katalog został zablokowany przez robots.txt i dodatkowo skierowany na 404 przez błędne reguły rewrite. Przywrócenie indeksacji wymagało trzech technicznych poprawek: odblokowania robots, przywrócenia prawidłowych 301 dla najważniejszych kategorii i poprawy sitemap, a następnie ponownego zgłoszenia sitemap do Search Console. Podczas audytu wykorzystaliśmy elementy z oceny potencjału SEO aby ustalić priorytety napraw.

Szybkie zmiany treści i struktury linków bez aktualizacji sitemap mogą skutkować natychmiastowym spadkiem indeksacji. Zobacz też praktyczne wskazówki z optymalizacji treści i sposób, w jaki linki wspierają indeksację w strategii link building.

Priorytety napraw

Równoległe działania mają sens tylko po właściwej diagnostyce. Kolejność, która działa praktycznie zawsze: 1) sprawdź dostępność serwera i kody HTTP, 2) zweryfikuj robots.txt i meta robots, 3) zgłoś lub napraw sitemap.xml, 4) popraw canonicale i parametry URL, 5) przywróć kluczowe 301 i strukturę linków wewnętrznych. Monitoruj zmiany w Statystykach indeksowania i w logach serwera przez minimum 48–72 godziny po wdrożeniu.

Terminy techniczne obokwyjaśnień: crawl budget — liczba żądań Googlebota na domenę; canonical — tag wskazujący wersję preferowaną; sitemap.xml — lista URL przesyłana do wyszukiwarki; HTTP 5xx/4xx — kody odpowiedzi mówiące o błędach serwera lub brakach zasobu; robots.txt — instrukcja dla robotów ograniczająca crawlowanie.

FAQ

Jak długo trwa przywrócenie indeksacji po naprawie błędów — zwykle widoczne zmiany w Statystykach indeksowania po 24–72 godzinach, pełna odbudowa może trwać dłużej przy dużych serwisach.

Czy sitemap wystarczy, by Google zaindeksował wszystkie strony — Sitemap ułatwia znalezienie URL.

Co zrobić, gdy po naprawach indeksacja się nie poprawia — to sygnał, że problem może leżeć w architekturze, hostingu lub jakości sygnałów indeksacyjnych i wymaga pełnego audytu technicznego.

Te artykuły mogą Cię zainteresować:

- Jak sprawdzić czy Twoja strona ma potencjał SEO — narzędzia i metryki do szybkiej oceny serwisu.

- Jak pisać teksty pod SEO bez lania wody — mikrostruktura i krótkie zdania, które pomagają indeksacji.

- Jak zdobywać linki w 2026 – metody, które nadal działają — sposób łączenia linków i treści dla lepszej dystrybucji crawl budget.

Krótko: 18 wysokiej jakości odnośników z branżowych domen potrafi podnieść ruch o około +38% w 12 miesięcy, ale to nie magia — to efekt współdziałania linków, wzmiankowań marki i danych strukturalnych [...]

Krótko: 18 wysokiej jakości odnośników z branżowych domen potrafi podnieść ruch o około +38% w 12 miesięcy, ale to nie magia — to efekt współdziałania linków, wzmiankowań marki i danych strukturalnych [...] Core Web Vitals to zestaw sygnałów UX — LCP, CLS i INP (dawniej FID) — które mierzyć i optymalizować, ale ich bezpośredni wpływ na pozycję w Google jest zazwyczaj marginalny w porównaniu z treścią i l [...]

Core Web Vitals to zestaw sygnałów UX — LCP, CLS i INP (dawniej FID) — które mierzyć i optymalizować, ale ich bezpośredni wpływ na pozycję w Google jest zazwyczaj marginalny w porównaniu z treścią i l [...]